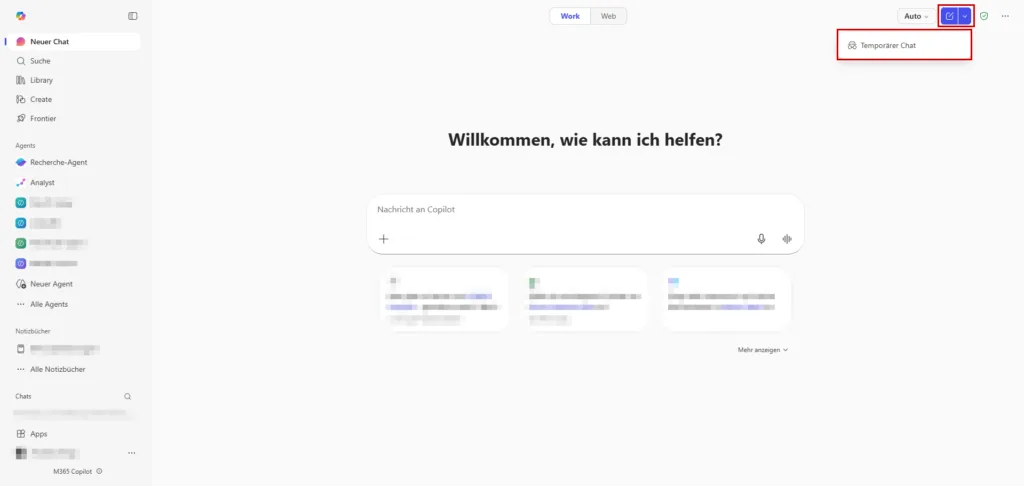

Vielleicht ist Dir der neue Schalter im Microsoft 365 Copilot schon aufgefallen. Microsoft hat hier eine Funktion nachgerüstet, die viele User bereits von ChatGPT oder Perplexity kennen: den Temporären Chat.

Doch während sich Endanwender über mehr Privatsphäre freuen, sollten bei Dir als Admin die Alarmglocken läuten, oder zumindest Fragen aufkommen. Was bedeutet „temporär“ in einer regulierten Microsoft-365-Umgebung wirklich?

Sind die Daten tatsächlich unwiderruflich gelöscht, sobald der Browser-Tab oder das Teams-Fenster geschlossen wird?

Voraussetzungen & Szenario

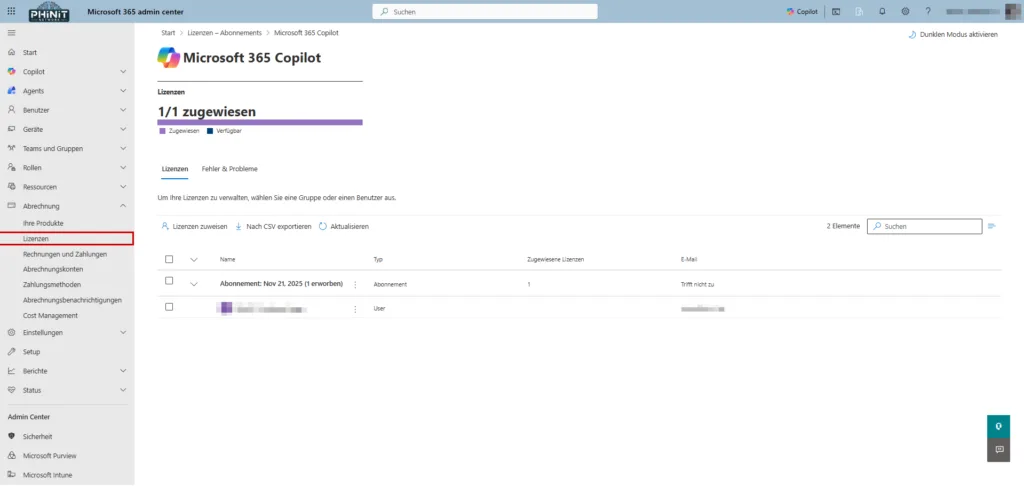

Damit Du dem Guide folgen kannst, gehen wir von folgendem Setup aus:

- Admin-Rollen: Für den Compliance-Check benötigst Du Zugriff auf Microsoft Purview.

- Lizenz: Aktive Microsoft 365 Copilot Lizenz (mit Graph-Zugriff auf M365-Daten).

- Tools: Zugriff auf das Microsoft 365 Admin Center und Microsoft Purview

Was ist der temporäre Chat?

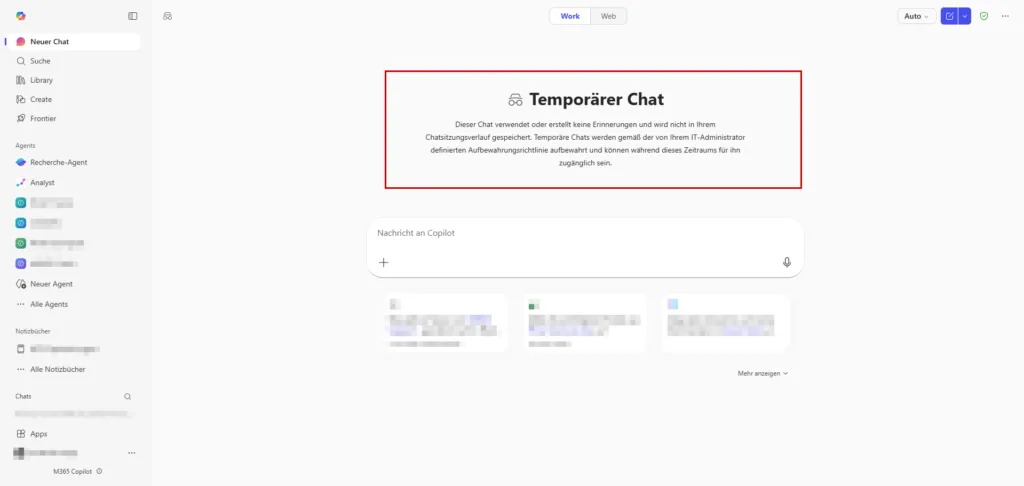

Technisch gesehen ist der temporäre Chat eine Sitzung, die isoliert vom persistenten Speicher des Copiloten läuft. Er ermöglicht Dir, mit der KI zu interagieren, ohne dass die Konversation im Verlauf („Conversations“) abgelegt wird. Das ist besonders relevant für Ad-hoc-Anfragen, die nicht Teil Deines langfristigen Arbeitskontextes werden sollen.

Die Kernmerkmale im Überblick:

- Kein Verlauf im Frontend: Sobald Du den Browser-Tab schließt oder die Sitzung beendest, verschwindet der Chat aus der Benutzeroberfläche. Ein späteres Fortsetzen („Resume“) ist nicht möglich.

- Kein „Gedächtnis“ (Memory): Die Inhalte tragen nicht zu den langfristigen Erinnerungen bei, die Copilot normalerweise aufbaut, um Antworten zu personalisieren. Deine Eingaben in diesem Modus beeinflussen also nicht das Verhalten des Copiloten in zukünftigen Sitzungen.

- Funktionalität & Einschränkungen: Grundlegende Funktionen wie Zitate und Quellenverweise auf Unternehmensdaten funktionieren wie gewohnt.

- Hinweis: Aktuell kann es Einschränkungen bei der Modellauswahl geben (z. B. Zugriff auf die allerneuesten Modell-Iterationen wie GPT-4o-Erweiterungen oder zukünftige Versionen), da der Fokus hier auf Schnelligkeit und Flüchtigkeit liegt.

Wann ist das sinnvoll?

Microsoft positioniert den temporären Chat für Szenarien, in denen eine gewisse „Spurenlosigkeit“ auf der Benutzeroberfläche gewünscht ist. Es geht hier primär um Hygiene im Chatverlauf und die Kontrolle darüber, was die KI über den Nutzer „lernt“.

Sinnvolle Anwendungsfälle sind:

- Brainstorming & Entwürfe: Schnelle Ideenfindung, ohne den regulären Chatverlauf („Conversations“) mit unfertigen Gedankenschnipseln zu verstopfen.

- Vermeidung von „Memory“-Einträgen: Wenn Nutzer verhindern wollen, dass bestimmte Kontextinformationen (z. B. vertrauliche Projektinterna oder private Notizen) im Langzeitgedächtnis des Copiloten landen und später ungewollt als Vorschlag wieder auftauchen.

- Einmalige Aufgaben (One-offs): Klassische „Fire-and-Forget“-Aufgaben wie schnelle Übersetzungen, Zusammenfassungen einer E-Mail oder Code-Snippets, die später nicht mehr referenziert werden müssen.

Tipp: Da der Verlauf unwiderruflich gelöscht wird, sobald das Fenster schließt, ist Vorsicht geboten. Wenn Du Ergebnisse aus einem temporären Chat doch behalten möchtest, musst Du diese aktiv sichern.

Nutze dazu Copilot Pages oder kopiere den Text klassisch in Word oder OneNote.

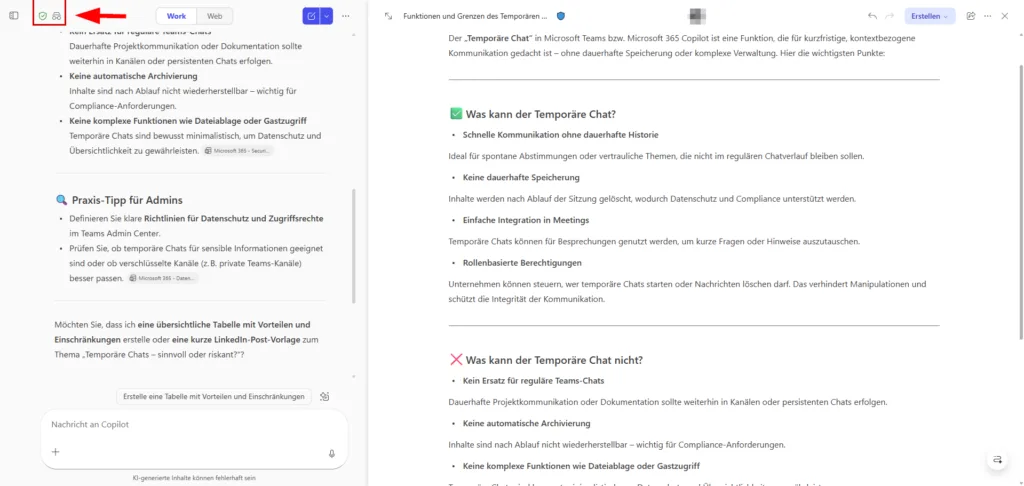

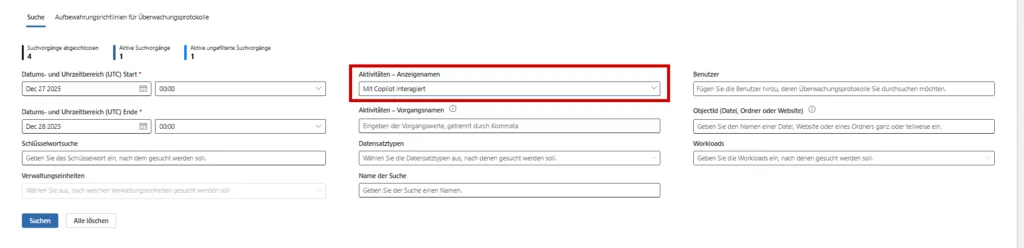

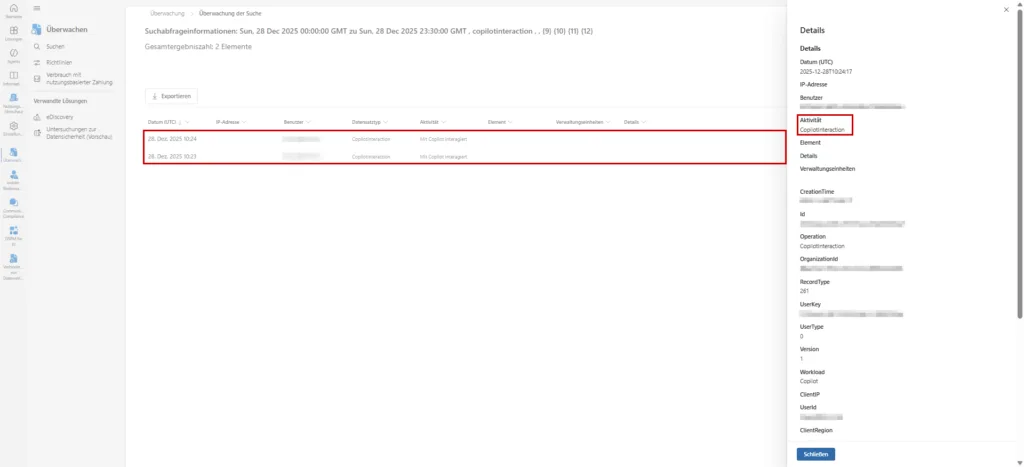

Compliance & Audit-Logs

Hier kommt der wichtigste Punkt für Dich als Admin oder Compliance-Officer: Temporär bedeutet nicht unsichtbar.

Auch wenn der Chat aus der Sicht des Endanwenders verschwindet, bleibt er für das Unternehmen revisionssicher nachvollziehbar. Microsoft speichert die Interaktionen im Backend, um regulatorischen Anforderungen gerecht zu werden. Ein „Geheim-Modus“ existiert in der Enterprise-Welt faktisch nicht.

Wo die Daten verbleiben:

- Microsoft 365 Audit Logs: Die Interaktionen erzeugen weiterhin Events in den Audit-Logs.

- Compliance-Kopien (eDiscovery): Die Chat-Inhalte landen im versteckten Ordner

TeamsMessagesDataim Exchange-Postfach des Nutzers (Substrate). Damit sind sie über eDiscovery und Content Search vollständig auffindbar und exportierbar. - Graph API: Über die

AiInteractionHistory-API kannst Du (oder Deine Security-Tools) weiterhin programmatisch abrufen, wer wann welchen Prompt gesendet hat.

⚠️ Wichtiger Hinweis: Wenn Du das Feature testen willst, wundere Dich nicht, wenn der Eintrag nicht sofort erscheint. Die Microsoft 365 Audit Logs arbeiten nicht in Echtzeit. Es kann erfahrungsgemäß 30 bis 90 Minuten (in Spitzenzeiten bis zu 24h) dauern, bis die Copilot-Interaktion im Purview-Portal indexiert und durchsuchbar ist.

Das Fazit für Deine Security-Strategie: Wenn Mitarbeiter den temporären Chat nutzen, um Aktionen durchzuführen, die gegen Unternehmensrichtlinien verstoßen – in der Hoffnung, keine Spuren zu hinterlassen – ist das ein Trugschluss. Die „Shadow IT“-Gefahr ist hier geringer als vermutet, da Du weiterhin Zugriff auf die Interaktionshistorie hast.

Fazit

Der temporäre Chat ist primär ein Usability-Feature, kein Security-Feature. Er ist eine willkommene Ergänzung, um den digitalen Arbeitsplatz sauber zu halten. Er verhindert, dass der Copilot-Verlauf mit Trivialitäten „zugemüllt“ wird und sorgt dafür, dass wilde Brainstorming-Sessions nicht das langfristige Gedächtnis (Memory) der KI verfälschen.

Das Wichtigste für Dich als Admin: Aus Sicht der IT-Sicherheit und Compliance ändert sich nichts. In einer Enterprise-Umgebung gibt es keinen echten „Geheim-Modus“. Jede Interaktion mit der Unternehmens-KI bleibt – wie wir in den Audit-Logs gesehen haben – revisionssicher und nachvollziehbar.

Es lohnt sich, die Anwender genau darüber aufzuklären: Temporär heißt „nicht sichtbar im Client“, aber nicht „gelöscht aus dem System“.

weitere Quellen

| offizielle Datenschutzdokumentation | https://learn.microsoft.com/de-de/copilot/microsoft-365/microsoft-365-copilot-privacy |

| Microsoft Purview Audit Logs | https://learn.microsoft.com/de-de/purview/audit-search |

Sei der Erste und starte die Diskussion mit einem hilfreichen Beitrag.

Kommentar hinterlassen

Dein Beitrag wird vor der Veröffentlichung kurz geprüft — fachlich, respektvoll und auf den Punkt ist hier genau richtig.